Für viele Sicherheitsverantwortliche steht der gefährlichste Angreifer nicht draußen, sondern ist bereits drinnen. Insider-Bedrohungen, ob von böswilligen Mitarbeitern oder abtrünnigen Administratoren, haben bereits die schwierigste Hürde eines Angriffs genommen: Sie haben sich Zugang verschafft, oft sogar privilegierten Zugang. Das bedeutet, dass sie mit vertrauenswürdigen Anmeldeinformationen, bestehenden Berechtigungen und intimen Kenntnissen über Ihre Systeme und Daten arbeiten können.

Aus diesem Grund sind Insider-Bedrohungen oft schwerer zu erkennen und einzudämmen. Laut dem IBM-Bericht "Cost of a Data Breach 2025" kosten böswillige Insider-Angriffe im Durchschnitt 4,92 Millionen US-Dollar und es dauert 260 Tage, bis sie aufgeklärt sind - damit gehören sie zu den teuersten und langlebigsten Vorfällen, mit denen Sicherheitsverantwortliche konfrontiert sind.

Bei aktiven Vectra AI waren fast 4 von 10 der priorisierten Bedrohungen innerhalb eines Monats Insider-Bedrohungen. Das ist keine Seltenheit. Es passiert jetzt in realen Unternehmensumgebungen, und es passiert häufig.

Was sind die Lücken in den Programmen zur Bekämpfung von Insider-Bedrohungen?

Selbst die ausgereiftesten Sicherheitsprogramme verlassen sich oft auf ein vertrautes Trio von Tools für das Risiko von Insider-Bedrohungen, aber jedes hat einen blinden Fleck, den Angreifer ausnutzen:

- DLP - Kennzeichnet oder blockiert bestimmte Datenübertragungen, kann aber die Absicht nicht erkennen. Wenn ein Insider sensible Dateien herunterlädt, auf die er zugreifen darf, betrachtet DLP dies als normale Geschäftsaktivität.

- EDR - Hervorragend geeignet zum Aufspüren von malware und endpoint , aber blind für Kontomissbrauch in SaaS-, cloud und Identitätsebenen, wo sich viele Insider-Vorfälle ereignen.

- SIEM - Fasst Protokolle für die Untersuchung zusammen, stellt aber keine Verbindung zwischen subtilen, separaten Aktionen in verschiedenen Systemen her, ohne eine umfangreiche manuelle Korrelation vorzunehmen.

Diese Lücken bestehen, weil Insider mit legitimen Berechtigungen arbeiten. Ihre Handlungen fügen sich in routinemäßige Arbeitsabläufe ein und umgehen präventiv ausgerichtete Kontrollen. Ohne die Korrelation von Verhaltensweisen über Identitäten, cloud und On-Premise-Netzwerk bleiben die Anzeichen verstreut und unerkannt.

Das Ergebnis? Bis eine Insider-Bedrohung für diese Tools offensichtlich wird, sind sensible Daten bereits weg oder der Schaden ist bereits angerichtet.

Wie erhöht die generative KI das Risiko von Insider-Bedrohungen?

Der Aufstieg der generativen KI am Arbeitsplatz, insbesondere Tools wie Copilot für Microsoft 365, bringt eine neue Dimension der Insider-Bedrohungen mit sich.

Wenn ein böswilliger Insider oder ein kompromittiertes Konto Zugriff auf Copilot hat, kann er die einheitliche KI-Suche nutzen, um Word, SharePoint, Teams, Exchange und andere Microsoft-Oberflächen in Sekundenschnelle zu durchsuchen. Sensible Daten, deren manuelle Suche Stunden oder Tage gedauert hätte, können fast augenblicklich entdeckt und für die Exfiltration bereitgestellt werden.

Warum dies für Insider-Bedrohungen von Bedeutung ist:

- Beschleunigte Erkundung. Copilot beseitigt die Latenzzeit in der Erkundungsphase. Ein Insider kann Anmeldeinformationen, Finanzdaten oder geistiges Eigentum mit der Geschwindigkeit der KI aufdecken.

- Der Vorteil, von der Natur zu leben. Angreifer nutzen bestehende Berechtigungen und vertrauenswürdige KI-Tools des Unternehmens und mischen sich nahtlos unter die legitimen Benutzeraktivitäten.

- Begrenzte native Sichtbarkeit. Sicherheitsteams sehen nur minimale Details in den Copilot-Auditprotokollen, so dass es schwierig ist, herauszufinden, wonach gesucht wurde oder was zurückgegeben wurde.

- Unzureichende systemeigene Kontrollen. Eingebaute Copilot-Beschränkungen halten entschlossene Insider kaum davon ab, die Umgebung nach sensiblen Informationen zu durchsuchen, und native Tools erkennen nicht, wenn Angreifer eine Identität kompromittieren, um die legitime Nutzung von Copilot für M365 zu missbrauchen.

Warum sind Insider-Bedrohungen so schwer zu erkennen?

Normales und bösartiges Verhalten sind ohne Kontext fast nicht zu unterscheiden:

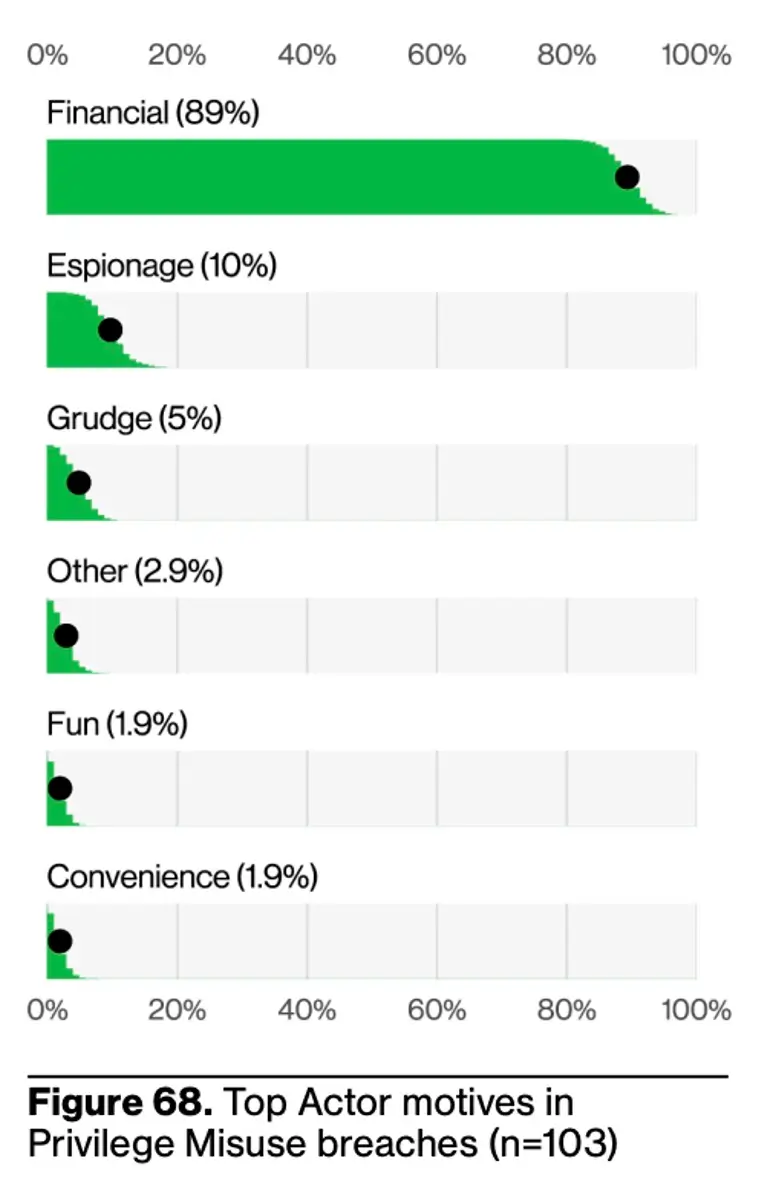

Die Herausforderung wird durch die Motivation und die Möglichkeiten noch verstärkt. Laut dem Verizon 2025 Data Breach Investigation Report ist die überwiegende Mehrheit der Insider-Vorfälle finanziell motiviert, wobei böswillige Administratoren das am stärksten gefährdete Risiko darstellen. In cloud Umgebungen können sensible Daten in Sekundenschnelle identifiziert und gestohlen werden, lange bevor die meisten Sicherheitsteams Zeit haben, zu reagieren.

Nach Angaben von Verizon sind 90 % der Hauptakteure bei Verstößen gegen die Rechtevergabe intern und 10 % sind Partner. Finanzielle Anreize sind nach wie vor das Hauptmotiv.

Der Schlüssel liegt darin, zu verstehen, wie der Zugang genutzt wird - die Abfolge, der Kontext und die Absicht hinter jeder Aktion - und nicht nur, dass der Zugang erfolgt ist. Die Erkennung echter Insider-Bedrohungen erfordert verhaltensbasierte KI, die böswillige Absichten von alltäglichen Anomalien unterscheiden kann.

Drei strategische Prioritäten zur Stärkung von Programmen zur Bekämpfung von Insider-Bedrohungen

1. Erweitern Sie die Sichtbarkeit des Identitätsverhaltens in allen Umgebungen

Insider arbeiten über Active Directory, M365, SharePoint, Teams, Exchange, Entra ID, Copilot für M365, Cloud und Netzwerkressourcen hinweg. Ohne Korrelation scheint jede Aktion für sich genommen harmlos zu sein. Die Sichtbarkeit der Identität über die gesamte Oberfläche ist unerlässlich.

2. Böswillige Absichten früher in der Kill Chain erkennen

Privilegienerweiterung, ungewöhnliche Datenbereitstellung und Persistenzmechanismen treten oft Tage oder Wochen vor der Exfiltration auf. Eine frühzeitige Erkennung in diesem Stadium reduziert die Auswirkungen und Reaktionskosten erheblich.

3. Korrelieren und Konsolidieren von Aufdeckungen für eine entscheidende Reaktion

Sicherheitsteams können nicht jede Anomalie untersuchen. Behavioral Monitoring destilliert Tausende von Low-Level-Ereignissen in eine Handvoll hochgradig vertrauenswürdiger Fälle mit vollständigem Kontext und ermöglicht so schnelles und sicheres Handeln.

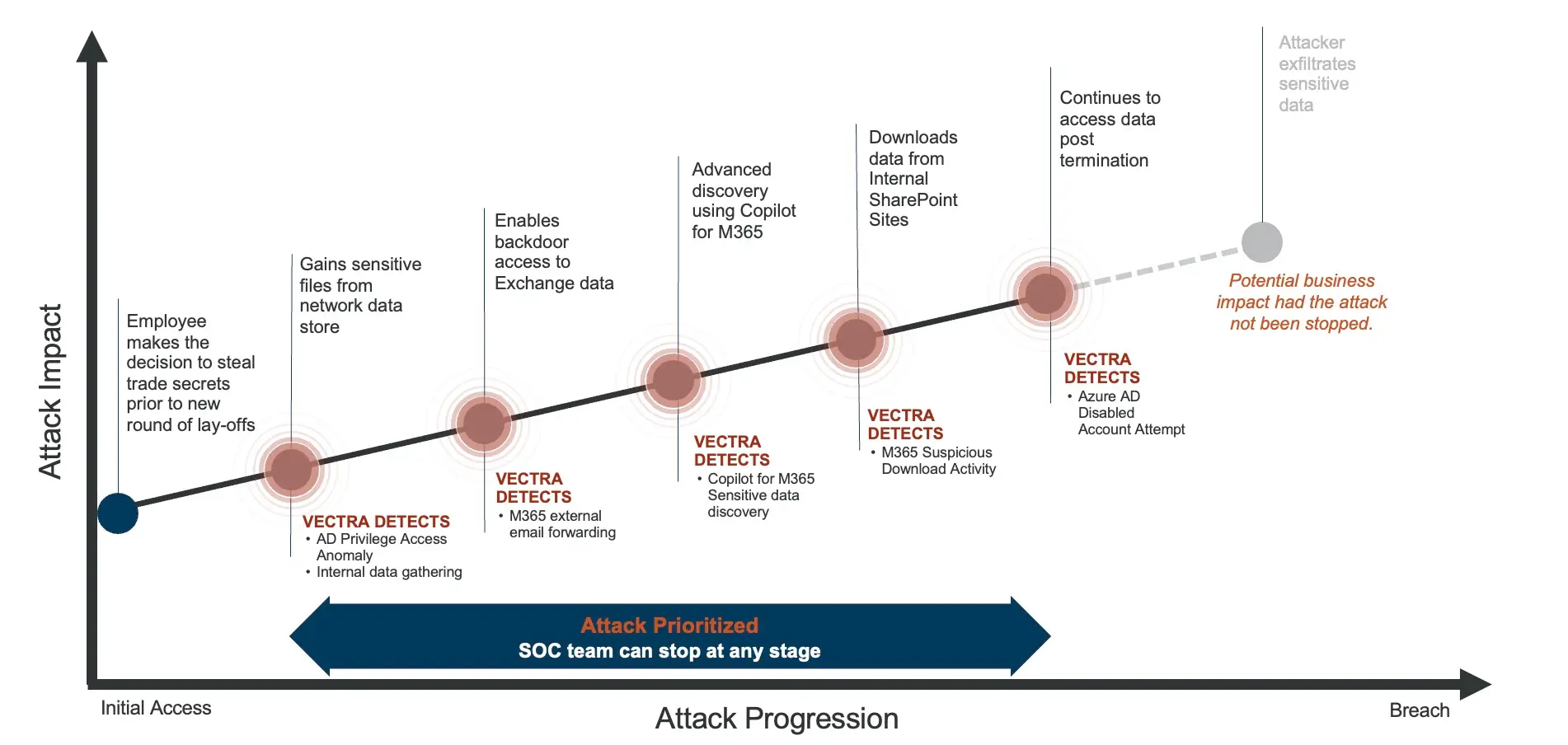

Ein Fall aus der Praxis: Wie Vectra AI eine Insider-Bedrohung abwehrte

In einem Industriebetrieb ist ein IT-Administrator über bevorstehende Entlassungen informiert:

- Sammeln von sensiblen Dateien aus Netzwerk-Datenspeichern.

- Weiterleitung von Exchange-E-Mails an ein externes Konto.

- Ich habe Copilot für M365 genutzt, um sensible Daten zu identifizieren

- Heruntergeladene SharePoint-Daten außerhalb der normalen Muster.

- Versuchte Anmeldungen bei deaktivierten Konten nach der Beendigung.

Herkömmliche Kontrollen konnten diese Aktionen nicht rechtzeitig verbinden. Vectra AI hat es geschafft - sie hat jeden Schritt zu einem einzigen, hochgradig vertrauenswürdigen Fall korreliert, der eine rasche Eindämmung ermöglicht und rechtliche Schritte unterstützt.

Der Vectra AI bei Insider-Bedrohungen

- Nachgewiesene Risikominderung. Erkennt und stoppt Insider-Bedrohungen früher und minimiert so die finanziellen und betrieblichen Auswirkungen.

- Verhaltensbasierte KI-Erkennung. Fügt die verhaltensbasierte Ebene hinzu, die bei präventionslastigen Programmen fehlt.

- Mehrflächige Sichtbarkeit. Die Identität, cloudGen AI und Netzwerk, in einer korrelierten Ansicht.

- Rauschunterdrückung in großem Maßstab. 99,98 % der Erkennungen werden laut Vectra AI Research gefiltert, bevor sie die Analysten erreichen .

- Ermöglicht die schnelle Eindämmung von Untersuchungen. Von automatischen Kontosperrungen bis hin zu vollständigem Metadatenkontext, um den Missbrauch zu stoppen, bevor Daten verloren gehen, und um zu verstehen, auf welche Dateien zugegriffen wurde und wie weit der Angriff reichte.

- Lässt sich in vorhandene Tools integrieren. Ergänzt und stärkt DLP, EDR und SIEM, um das Risiko von Insider-Bedrohungen zu verringern, ohne Ihre bestehenden Arbeitsabläufe zu ändern.

Insider-Bedrohungen sind nicht nur ein Problem der Einhaltung von Vorschriften - sie sind ein wesentliches Geschäftsrisiko. Um ihnen zu begegnen, muss man über die Inhaltskontrolle hinausgehen und zu einer identitätsbasierten Verhaltenserkennung übergehen.

Der Insider ist bereits drinnen. Die Frage ist: Werden Sie rechtzeitig erkennen, was sie tun, um sie aufzuhalten?

Machen Sie den nächsten Schritt beim Schutz vor Insider-Bedrohungen

Insider-Bedrohungen erfordern mehr als nur Präventionskontrollen. Sie erfordern eine verhaltensbasierte KI-Erkennung, die böswillige Absichten in Echtzeit und über alle Identitäten und Umgebungen hinweg erkennen kann. Sind Sie bereit, Ihr Programm zur Erkennung von Insider-Bedrohungen zu stärken? Sehen Sie die Vectra AI in Aktion: